您現在的位置是:首頁 > 藝術

基於CNN的歌聲合成演算法論文解讀

怎麼測歌聲的實際音高

資料

https://n3utrino。work/

前沿

Title:Singing voice synthesis based on convolutional neural networks

核心思路:midi 輸入到CNN,預測聲學特徵(acoustic feature),聲學特徵輸入到聲碼器得到音訊。

一句話:運用CNN模型將樂譜序列對映到聲學特徵

深度神經網路是人工神經網路,其包含很多隱含層。給語音合成和歌聲合成帶來機遇。其次在DNN的歌聲合成方法中,DNN作為聲學模型,就是實驗從樂譜特徵到聲學特徵的對映。

神經網路還可以對波形直接建模,例如wavenet、SampleRNN、WaveRNN、FFTnet、WaveGlow。神經王座作為聲碼器改變了語音合成的質量。神經網路聲碼器以聲學特徵作為輸入。歌聲合成最關鍵的是利用樂譜資訊來預測聲學特徵。

前饋神經網路的侷限是無法考慮到語音的序列特性。語音的每幀之間有相關性,但是前饋網路是認為各個幀是相互獨立的。由此RNN和LSTM是一個很好解決辦法。此外,可以透過使用語音引數生成演算法對預測的聲學特徵進行平滑處理來緩解此問題,該演算法利用動態特徵作為約束來生成平滑的語音引數軌跡。

基於DNN的歌聲合成

歌聲合成系統與語音合成系統很像。但是又有本質的不同。結構如下圖:

主要包括訓練部分和合成部分,訓練部分:從資料集中提取光譜,激發和顫音引數作為聲學特徵,樂譜特徵和聲學特徵依據訓練好HMM模型來對齊。

輸入引數:節奏和速度是樂譜中重要的特徵,顫音是一個重要的演唱技巧必須被建模。本文假定顫音是F0的週期波動。顫音用正弦函式建模。

ma(t)(顫音的F0振幅), mf (t)(顫音的F0頻率), 和 fs移碼

基於統計學的引數合成方法是依賴於語料庫的。音高應該正確的覆蓋全,生成的F0軌跡會極大地影響合成歌聲的質量。基於DNN的歌聲合成系統提出了音符級音高或分解技術。對從波形提取的log F0序列與音符音高之間的差異進行建模。

樂譜中的所有清音幀和音樂休息都被線性插值並建模為濁音幀。

顫音函式為:

基於CNN的歌聲合成

聲稱深度雙向LSTM-RNN可以生成平滑的語音引數軌跡,相對較長的樂譜功能序列(相當於幾秒到幾十秒)被視為一個片段,並由CNN同時轉換為聲學特徵序列。結構如下圖所示:

F(

)為幀的對映函式,G(

)為段的對映函式

如圖所示,第一部分是一個1x1的卷積層,將樂譜特徵轉化為一幀幀的序列。輟學方法用於保持針對未知樂譜的魯棒性。第二部分是1xN的卷積層,在第一部分的中間輸出特徵序列中,以片段為單位將其轉換為聲學特徵序列。聲學特徵的維度就是輸出特徵的頻道數。段的大小就是1xT,T就是每段的幀數。T的大小可以調整。

樂譜特徵序列

聲學特徵序列:

兩者之間的關係:

音高對歌聲合成的質量影響比較大。我們把樂譜的音高與第一部分的輸出拼接起來作為第二部分的輸入。透過樣本資料對齊音符並拼接logF0引數。初步的主觀實驗證實了使用從插值樂譜中提取的logF0引數的有效性。

損失函式

歌聲合成的引數特徵ot包括靜態特徵向量和動態特徵向量

歌聲引數向量和靜態特徵向量為

T為幀數,o與c的關係o=Wc,W為視窗矩陣。

樣本

取樣率 48KHZ

Windowed with a 5ms shift

量化位數是16bit

結論

基於卷積的神經網路歌聲合成器能很好地合成歌聲,以段落為單元轉化樂譜特徵序列為聲學特徵序列。無需引數合成演算法就可以訓練自然語音引數軌跡。並且能實現平行計算加快訓練速度。

推薦文章

- 評估機構未經法定程式選定,補償決定合法嗎?

xx區相關部門對涉案房屋進行評估,並於2019年3月11日作出《關於對羅x國有土地上房屋徵收補償的決定書》,且予以送達...

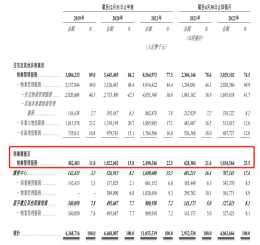

xx區相關部門對涉案房屋進行評估,並於2019年3月11日作出《關於對羅x國有土地上房屋徵收補償的決定書》,且予以送達... - 龍湖智創生活:蓄力靜候時機

高質量規模增長在“物管”和“商管”之間端平了水,龍湖智創生活業務涵蓋住宅及其他非商業物業管理服務,和商業運營管理服務...

高質量規模增長在“物管”和“商管”之間端平了水,龍湖智創生活業務涵蓋住宅及其他非商業物業管理服務,和商業運營管理服務... - “4種菜”很好養,種幾盆陽臺上,一直旺長得快,吃到過年沒問題

冬季也可以種植,只要溫度不太低,它的發芽速度就超級快的,而且生長週期一個多月的時間,就能吃了,多曬太陽,少澆點水,多施點肥,自然就會長得特別茂盛,葉子大綠油油的...

冬季也可以種植,只要溫度不太低,它的發芽速度就超級快的,而且生長週期一個多月的時間,就能吃了,多曬太陽,少澆點水,多施點肥,自然就會長得特別茂盛,葉子大綠油油的...